Storie di Stadio / 45 anni fa il dramma di Vincenzo Paparelli

14 Ottobre 2024

Azzorre, un toscano le conquista con il suo food truck

15 Ottobre 2024La sorveglianza AI, per il fondatore di Oracle

La sicurezza con l’Intelligenza Artificiale di Larry Ellison: un futuro distopico già presente

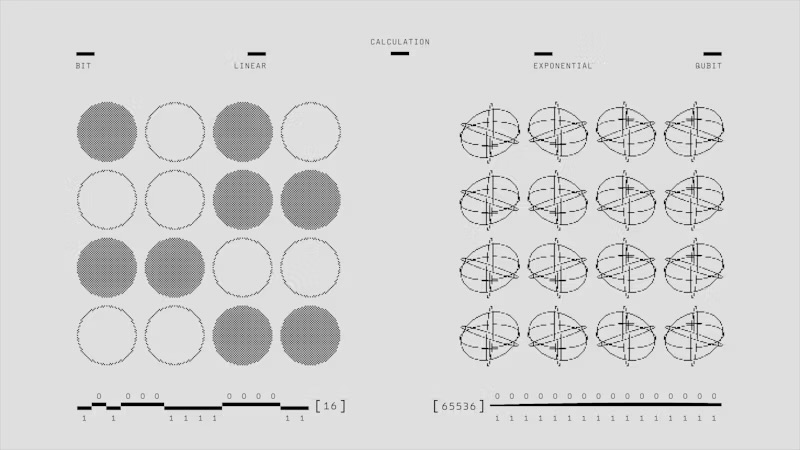

C’è una frase che viene ripetuta spesso sui social media quando si parla di nuove tecnologie di sorveglianza: “1984 doveva essere un avvertimento, non un manuale di istruzioni!”. Sebbene possa sembrare ormai scontata, rimane un riflesso di una paura tangibile. Oggi, la realtà supera l’incubo descritto da Orwell, specialmente quando ascoltiamo le parole di Larry Ellison, fondatore e CEO di Oracle, il quale propone una visione di un futuro in cui l’intelligenza artificiale alimenta un sistema di sorveglianza costante e onnipresente. Durante un recente incontro con investitori, Ellison ha delineato un piano audace per un sistema di sorveglianza integrato, combinando telecamere indossabili, droni e telecamere montate su veicoli, tutti interconnessi e monitorati dai data center di Oracle. “La polizia si comporterebbe al meglio, perché osserviamo e registriamo costantemente tutto ciò che accade,” ha affermato con una convinzione inquietante. Tuttavia, la realtà di tali sistemi solleva interrogativi preoccupanti. Non è solo un sogno futuristico; strumenti come i droni e le telecamere indossabili sono già attivi in diverse città. E mentre i sostenitori li pubblicizzano come soluzioni per la sicurezza, le testimonianze di chi vive sotto tali sorveglianze raccontano una storia ben diversa. Sicurezza nelle scuole: sorveglianza o illusione?

L’uso dell’intelligenza artificiale per la sicurezza nelle scuole

Uno degli aspetti più inquietanti della visione di Ellison è l’uso dell’intelligenza artificiale per migliorare la sicurezza nelle scuole. “Possiamo rendere le scuole assolutamente sicure utilizzando droni e telecamere connesse,” ha affermato con un ottimismo spiazzante. Tuttavia, la realtà è ben diversa. Molte scuole statunitensi hanno già implementato tecnologie di sorveglianza alimentate dall’intelligenza artificiale per rilevare armi o individui sospetti. In una scuola superiore di Houston, un insegnante ha raccontato un’esperienza traumatica: “Un giorno, l’allerta ha suonato perché un ragazzo aveva portato in aula un proiettore. La tecnologia ha fatto scattare un panico generale. Gli studenti si sono messi a piangere, e l’evacuazione è stata caotica. È stata una giornata da incubo.” Queste tecnologie, lungi dal garantire sicurezza, hanno generato solo confusione e paura. Anche un preside di una scuola del Texas ha commentato: “Le tecnologie hanno creato momenti di panico piuttosto che un vero senso di sicurezza. Un giorno abbiamo avuto un allerta per un’arma, e in realtà era solo un quaderno”. Nonostante le prove che tali strumenti non aumentano in modo significativo la sicurezza, le aziende di sorveglianza continuano a capitalizzare la paura di sparatorie scolastiche.

Bodycam: sorveglianza continua o falso senso di controllo?

Un altro punto cruciale del piano di Ellison riguarda le bodycam destinate alla polizia. Con un prezzo accessibile di 70 dollari, le bodycam sarebbero progettate per essere sempre attive e monitorate dall’intelligenza artificiale. “Le nostre bodycam registrano tutto, anche quando sembrano spente” ha avvertito Ellison, lasciando intendere che la sorveglianza è inesorabile. Tuttavia, esperti in privacy e diritti civili esprimono preoccupazioni. Una ricercatrice della Privacy Rights Clearinghouse ha dichiarato: “La registrazione continua non risolve i problemi di abuso; anzi, potrebbe amplificarli”. Questo fa sorgere la questione su chi avrà accesso ai dati registrati e come verranno utilizzati. La stessa Oracle potrebbe diventare un custode di informazioni sensibili, aumentando le preoccupazioni sulla trasparenza e sull’uso improprio dei dati. “La sorveglianza di per sé non è un male, ma il suo utilizzo può diventare facilmente abusivo,” ha aggiunto. Droni e intelligenza artificiale: controllo totale? Ellison ha anche presentato un sistema basato su droni per monitorare costantemente le comunità. “Un drone può intervenire molto più rapidamente di una volante,” ha affermato. Tuttavia, programmi già attivi in alcune città dimostrano che i droni non sempre operano come previsto. In diversi casi, sono stati utilizzati per monitorare eventi pubblici o attività innocue, suscitando il timore di un controllo eccessivo. Un attivista per i diritti civili, che ha seguito da vicino l’implementazione dei droni in alcune comunità, ha commentato: “È inquietante vedere i droni sorvegliare le persone che partecipano a eventi pubblici come concerti o celebrazioni. Non c’è alcuna giustificazione per questo, e fa sentire le persone come se vivessero sotto un regime di sorveglianza”. Queste tecnologie esistono già in una forma o nell’altra e, mentre sono promosse come strumenti per la sicurezza pubblica, il loro utilizzo ha sollevato preoccupazioni significative. Un futuro inquietante? La visione di Larry Ellison di una sorveglianza onnipresente alimentata dall’intelligenza artificiale non è una distopia futura; è già in fase di realizzazione. Molti degli strumenti descritti– dalle telecamere indossabili ai droni autonomi– sono già in uso e si stanno integrando nella vita quotidiana. Eppure, nonostante la promessa di maggiore sicurezza, queste tecnologie non hanno dimostrato di risolvere i problemi che intendono affrontare. Un ex-poliziotto che ha scelto di rimanere anonimo ha affermato: “Le bodycam e i droni sono solo strumenti; se non affrontiamo il problema più grande della cultura di abuso di potere nella polizia, non cambierà nulla”. L’idea che l’intelligenza artificiale possa garantire una supervisione impeccabile collide con la realtà di pregiudizi, errori e violazioni della privacy. Così, mentre aziende come Oracle continuano a promuovere il sogno di una sicurezza totale, resta da chiedersi: quanto siamo disposti a sacrificare in termini di libertà e privacy per inseguire una sicurezza che, in ultima analisi, potrebbe rivelarsi illusoria?